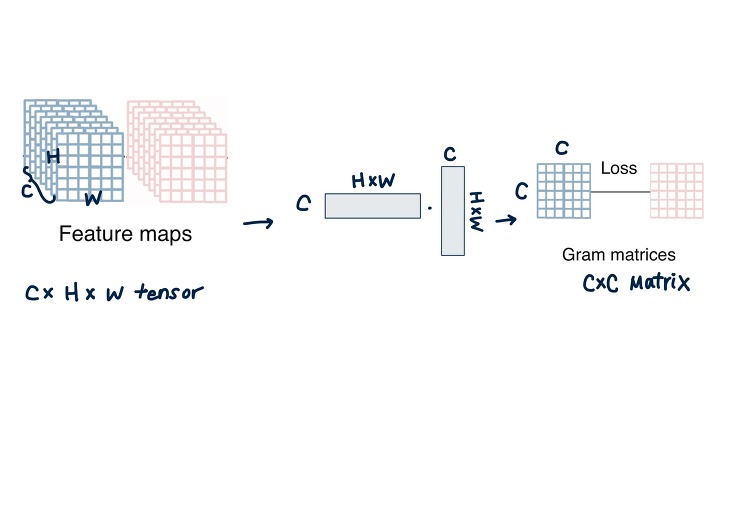

Perceptual Loss 는 GAN에서 사용되는 loss중 하나로 MAE(L1), MSE를 보완하기 위해 만들어진 손실함수입니다. Perceptual loss는 Content loss와 style loss 두 가지 종류가 있는데 Feature map을 그대로 사용하는 Content loss와 Gram matrix 연산을 한번 거쳐 Loss를 계산하는 Style loss가 있습니다. ▲ 왜 MAE, MSE가 적합하지 않은가?!! 더보기 MAE와 MSE는 둘 다 mean, 평균오차입니다. 여러가지 샘플이 존재할때, 그 평균에서 크게 벗어나지 않는것을 목표로 합니다. 따라서 generator의 목표가 진짜같은 이미지 a'보다는 a,b,c,d의 평균에서 최대한 가까운 a+b+c+d/4를 타겟으로 합니다. 그..