지난 글에서 요악한 FCN은 Transpose Convolution과 1x1 Convolution을 사용해 다양한 size의 feature map을 잘 섞어서 활용하였다.

이번 포스팅에서는 FCN의 한계점을 살펴보자.

1. 객체의 크기가 크거나 작은 경우 예측을 잘 하지 못한다.

-> 한마디로 너무 작거나 큰, 그런 극단적인 상황은 예측을 잘 하지 못한다.

왼쪽의 예시를 보면 object가 이미지의 거의 90프로를 차지할정도로 크다.

FCN을 사용하면 이런 큰 scale을 바라보지 못하고, 오히려 유리창에 비친 자전거등을 인식하는 경우도 발생한다.

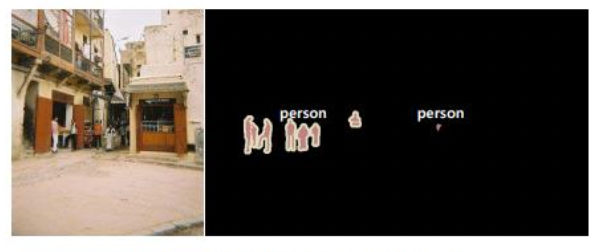

마찬가지로 물체가 너무 작을때도 문제가 발생한다.

작은 object는 무시되는 문제가 생기는데 이는 upconvolution 과정에서 pooling과정에서 국소적인 정보가 사라지기 때문이다.

2. Object의 디테일한 모습이 사라지는 문제가 발생한다

같은 맥락으로, 여러차례 Pooling에 비해 Deconvolution(Transpose)은 한번의 과정으로, 절차가 너무 간단하기 때문에

물체의 경계등을 학습하기 어렵고, 디테일하지 못한 문제가 발생한다.

이런 FCN의 한계점들을 개선한 모델에는 DeconvNet, SegNet 등이 있다.

자세한건 다음 포스팅에서 다룬다.

'2021 네이버 부스트캠프 - Ai tech' 카테고리의 다른 글

| Week 11/12/13 - Semantic Segmentation - DeepLab v1 (0) | 2021.12.15 |

|---|---|

| Week 11/12/13 - Semantic Segmentation - DeconvNet (0) | 2021.12.15 |

| Week 11/12/13 - Semantic Segmentation - FCN (0) | 2021.12.15 |

| Week 11/12/13 - What is Semantic Segmentation? (0) | 2021.12.15 |

| Week 11/12/13 Level2- P Stage [Semantic Segmentation] (0) | 2021.11.19 |